Cette lecture dédiée à l’intelligence artificielle (IA) constitue une suite au travail réalisé en 2020 avec le Laboratoire Modulaire-ésam Caen/Cherbourg et l’artiste Marion Balac à qui nous avons consacré une revue dans laquelle vous trouverez deux entretiens très clairs sur ce que sont les modèles de langage et comment ils sont utilisés :

https://www.esam-c2.fr/IMG/pdf/publi_marion_balac_2022.pdf

Cette lecture est aussi une étape vers une exploration plus profonde de la façon dont la question est abordée dans les médias.

Alexei Grinbaum dans ce court essai pose un certain nombre de points essentiels à comprendre et à intégrer concernant l’IA qui fait l’objet de tant d’interprétations approximatives voire quand ce n’est pas totalement stupide. Et comme par ailleurs, il connaît de l’intérieur la machine, il n’en est que plus pertinent.

Pour signifier que la question n’est pas nouvelle, il se réfère aux mythes, aux croyances ou aux textes sacrés. Ce n’est pas un livre technique, c’est un ouvrage à vocation philosophique et culturelle. Celles et ceux qui connaissent le sujet n’y apprendront « rien » mais y trouveront peut-être des arguments pour rendre clair ce qui ne l’est pas encore et pour tous les autres, ce sera une entrée en matière passionnante.

D’ici là, plusieurs points sont au cœur du livre :

• la technologie n’est pas neutre, elle agit toujours sur nous

« Aucune neutralité n’est possible. C’est pourquoi la génération automatique du langage, discipline jusque-là largement académique, implique une prise de position éthique et même politique. »

• on entend par « intelligence » un traitement logique de l’information dans un système complexe

« Les modèles de langue de grande taille élaborent des outputs très satisfaisants et parfaitement ressemblants à des réponses humaines, sans intégrer la dimension de sens. »

• une machine ne pense pas, ne raisonne pas, ne comprend pas, n’hallucine pas

« Les agents conversationnels génèrent des répliques vraisemblables et bien construites, mais le sens de ces énoncés existe uniquement du point de vue de l’interlocuteur humain. La sémantique ne fait pas partie du monde des machines, qui ne comprennent rien, ne raisonnent pas et ne savent pas distinguer le vrai du faux. »

• une machine est conçue pour faire ce qu’elle fait

« (…) la machine fait ce pour quoi elle a été conçue »

• une machine ne commet pas d’erreur, elle fonctionne ou pas

« La machine tourne parce qu’elle ne peut que tourner ou tomber en panne… »

• une machine n’est pas responsable

« Que la machine sache fabriquer un langage beau et cohérent, cela ne suffit pas pour la constituer en agent responsable. »

Le premier problème qui est posé est celui de notre tendance à projeter du sens là où il n’y en a pas et à anthropomorphiser la machine. En découle un deuxième problème qui celui des effets induits pour cette nouvelle croyance d’une vie machinique.

« Il existe bien une différence entre ce qu’une machine dit et ce qu’elle « comprend » ; d’ailleurs, elle ne comprends rien. Mais lorsqu’un modèle de langage crée chez l’utilisateur une illusion qui persévère et se renforce avec le temps, celui-ci acceptera in fine que la machine « connaît ». Ce qui, au début, n’est qu’un raccourci soumis à toutes les critiques finira par s’imposer en tant que nouvel usage normal du verbe « connaître ». »

(…)

« Malgré l’absence de l’équivalence physiologique et cognitive entre l’homme et la machine, une équivalence émotionnelle peut advenir purement par projection, de manière plus phénoménale qu’ontologique. Aucun ancrage substantialiste n’est nécessaire pour établir une relation ; celle-ci surgit spontanément de l’épais nuage qui sépare la machine de l’utilisateur et véhicule une éthique. Cette équivalence légère et apparente ouvrirait alors la porte à l’équivalence morale entre l’homme et la machine, avec des effets empiriques épouvantables. »

(…)

« Si l’interaction va croissant, la machine commence à modifier l’homme (…) Le monde visuel de la machine finira-t-il par ressembler au nôtre, parce que le nôtre évoluera pour inclure celui de la machine ? Le langage que nous utilisons évoluera-t)il sous l’influence des usages qu’en fait la machine ? Tout cela est possible. »

D’où l’impératif éthique des sciences humaines, de l’art et de la culture face à un ensemble de paramètres scientifiques, industriels, économiques, politiques, idéologiques et mystiques.

Ici une chronique d’Etienne klein sur l’ouvrage :

https://www.radiofrance.fr/franceculture/podcasts/le-pourquoi-du-comment-science/comment-le-numerique-nous-change-t-il-2687636

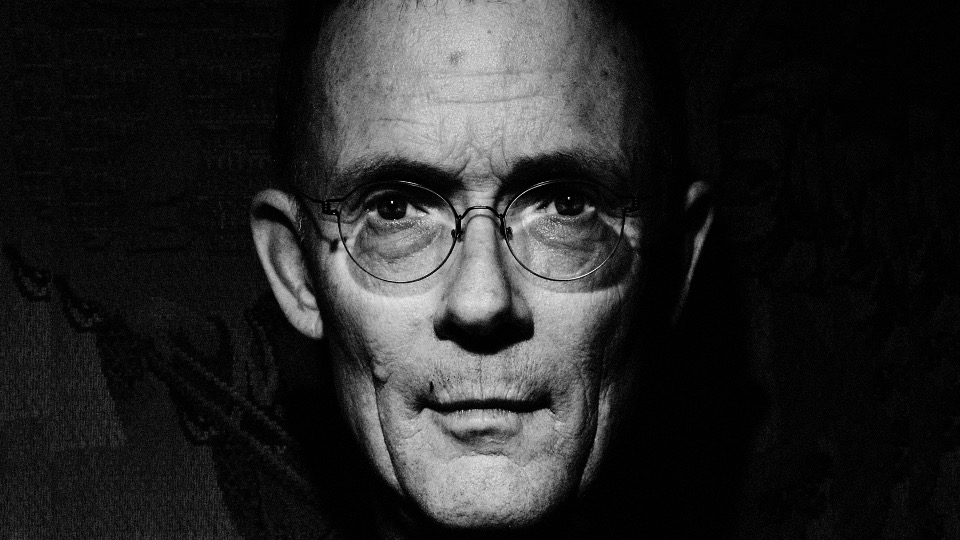

Alexei Grinbaum est directeur de recherche au CEA-Saclay. Il est spécialiste de la théorie de l’information quantique. Depuis 2003, il s’intéresse aux questions éthiques posées par les technologies (nanotechnologies, intelligence artificielle et robotique). Membre du Comité national pilote d’éthique du numérique, il est aussi expert de la Commission européenne et président du Comité opérationnel d’éthique du numérique du CEA.